Definir el rendimiento del control remoto

09 Apr 2026La palabra «rendimiento» significa cosas distintas según el ámbito. En el control remoto se entrelazan calidad de imagen, latencia y velocidad de actualización. La brecha entre expectativas y realidad — vivida en Indonesia y al usar soluciones reputadas por su rendimiento — fue el punto de partida del proyecto NovaLINK. Ningún software encaja a la perfección en todos los entornos, pero seguimos probando y desarrollando para alcanzar el rendimiento que perseguimos.

La expresión «buen rendimiento» cambia por completo según el contexto. En los juegos importan FPS y respuesta; en las bases de datos, caudal y estabilidad; en equipos de red, capacidad de procesamiento y latencia de paquetes. Sin una definición acorde al dominio, expectativas y resultados se desalinean. Si al adoptar una solución solo escribes «rendimiento» en una línea, luego cuesta fijar responsabilidades. Lo mismo ocurre con el control remoto y el streaming de pantalla: aunque se parezca al OTT o al videoconferencia por la transmisión en tiempo real, exigir respuesta inmediata del ratón y el teclado añade carga que el streaming «solo visual» no tiene. No basta con fluidez; hay que valorar también la respuesta de los controles. Aquí el rendimiento no es un solo número, sino varios factores a la vez.

Al hablar del rendimiento del control remoto suelen citarse: primero, calidad de la pantalla (algoritmo de compresión, bitrate, color) que afecta nitidez del texto y naturalidad de fotos y vídeos; segundo, latencia entre el envío de la entrada y el retorno de la imagen, que define la sensación de «respuesta»; tercero, frecuencia de actualización (FPS); cuarto, estrategia adaptativa cuando baja el ancho de banda; y por último, resiliencia a pérdida de paquetes, comportamiento con poco ancho de banda y carga CPU/GPU en cliente y servidor. El «rendimiento global» no se deduce de una sola cifra de benchmark.

Otro matiz: «producto famoso y caro» y «rendimiento percibido en mi entorno laboral» no siempre coinciden. Cuota mercado y listas de funciones orientan, pero cada empresa debe validar en su red y flujos de trabajo. Por eso preferimos ser transparentes sobre condiciones y mediciones antes que disputas abstractas de superioridad. Un buen «rendimiento» no es una línea en un ranking, sino cuán honestamente enfrentamos y reducimos las restricciones que tenemos delante.

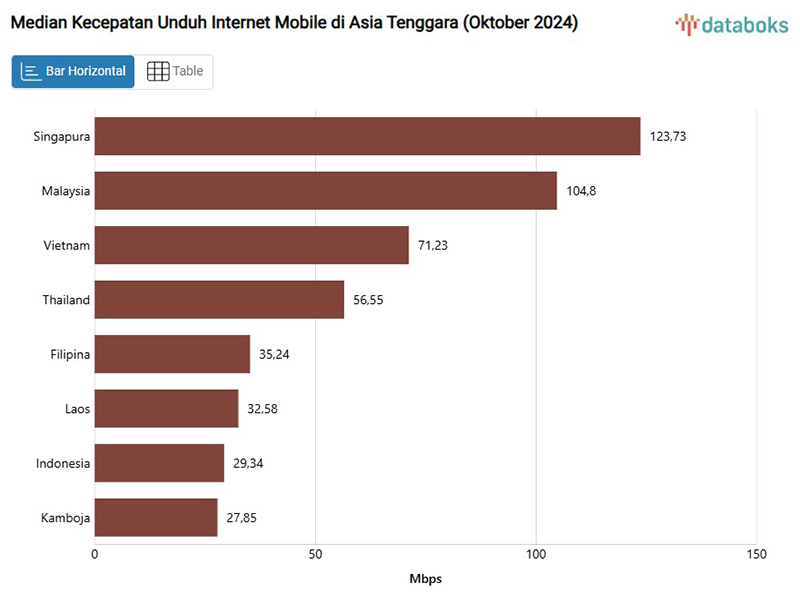

Desplegamos un ERP para una empresa en Purbalingga (Indonesia). Indonesia avanza rápido con enfoque móvil, pero la brecha entre capital y regiones sigue siendo grande. El internet del cliente variaba mucho según la hora y los cortes eran frecuentes, lo que impedía copiar modos de trabajo que asumen línea estable. A veces los registros no bastaban y había que reproducir pasos viendo la pantalla. Sin visitas presenciales siempre posibles, a menudo verificábamos a configuración, reproducíamos errores y formábamos usuarios en remoto. Si la sesión era lenta, distinguir red de aplicación era aún más difícil. En ese contexto elegíamos una solución con reputación de «buen rendimiento en control remoto»; adoptamos Teamviewer, muy usado en soporte remoto.

Velocidad de internet móvil en Indonesia sigue rezagada frente a otros países – Haninpost

Velocidad de internet móvil en Indonesia sigue rezagada frente a otros países – Haninpost

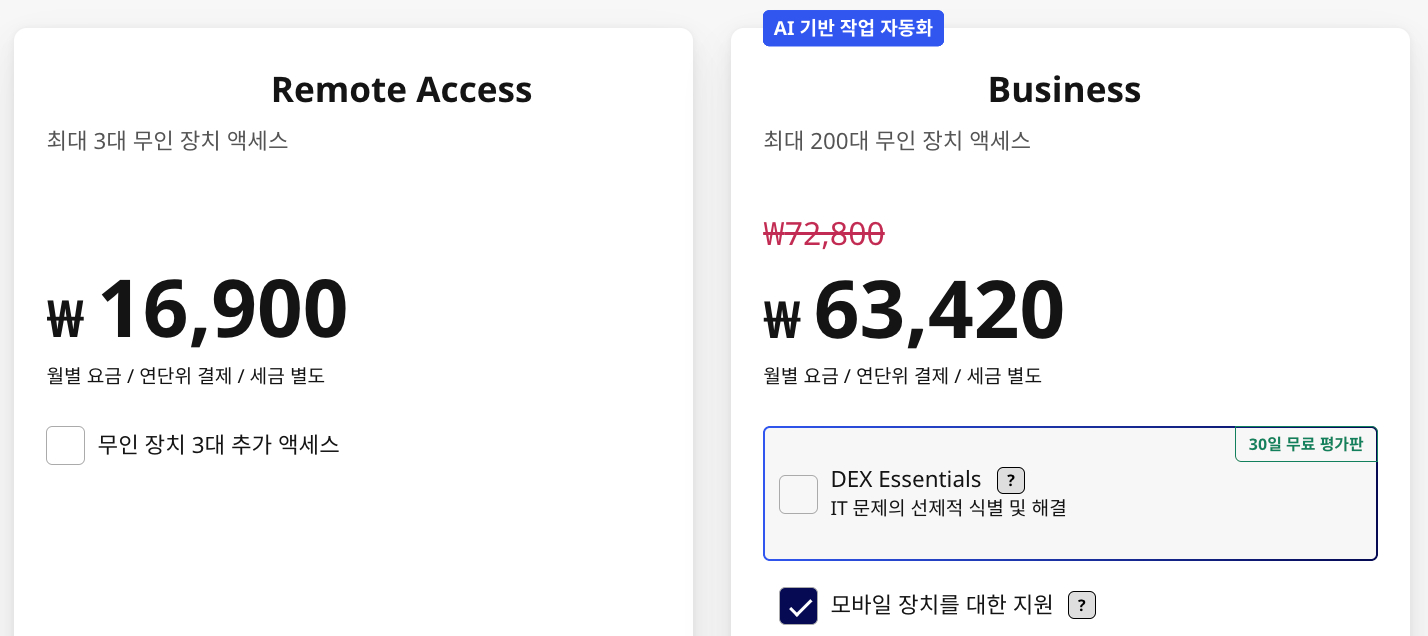

La solución de Teamviewer tiene fortalezas claras en funciones, ecosistema y soporte empresarial, pero la licencia es cara. Esperábamos al menos respuesta y nitidez claras en la pantalla remota por el coste. En la práctica, la experiencia a menudo quedó corta: con mala línea se acumulaba la latencia y la imagen se cortaba o se volvía borrosa; incluso abrir menús o rellenar formularios podía resultar frustrante. No esto niega el valor técnico global del producto: funciones probadas, experiencia operativa, plataformas y gestión por equipos siguen siendo valiosos. Pero en nuestro entorno la distancia entre «caro = rápido y fluido» y lo que sentíamos inspiró el nuevo proyecto. Partimos de: «¿Por qué bajo nuestras condiciones se siente tan lento?» Vimos de nuevo que un buen producto no garantiza la misma percepción si el entorno no ayuda y que cuanto peor la red, más importa que el software se comporte con inteligencia dentro de línea y dispositivos.

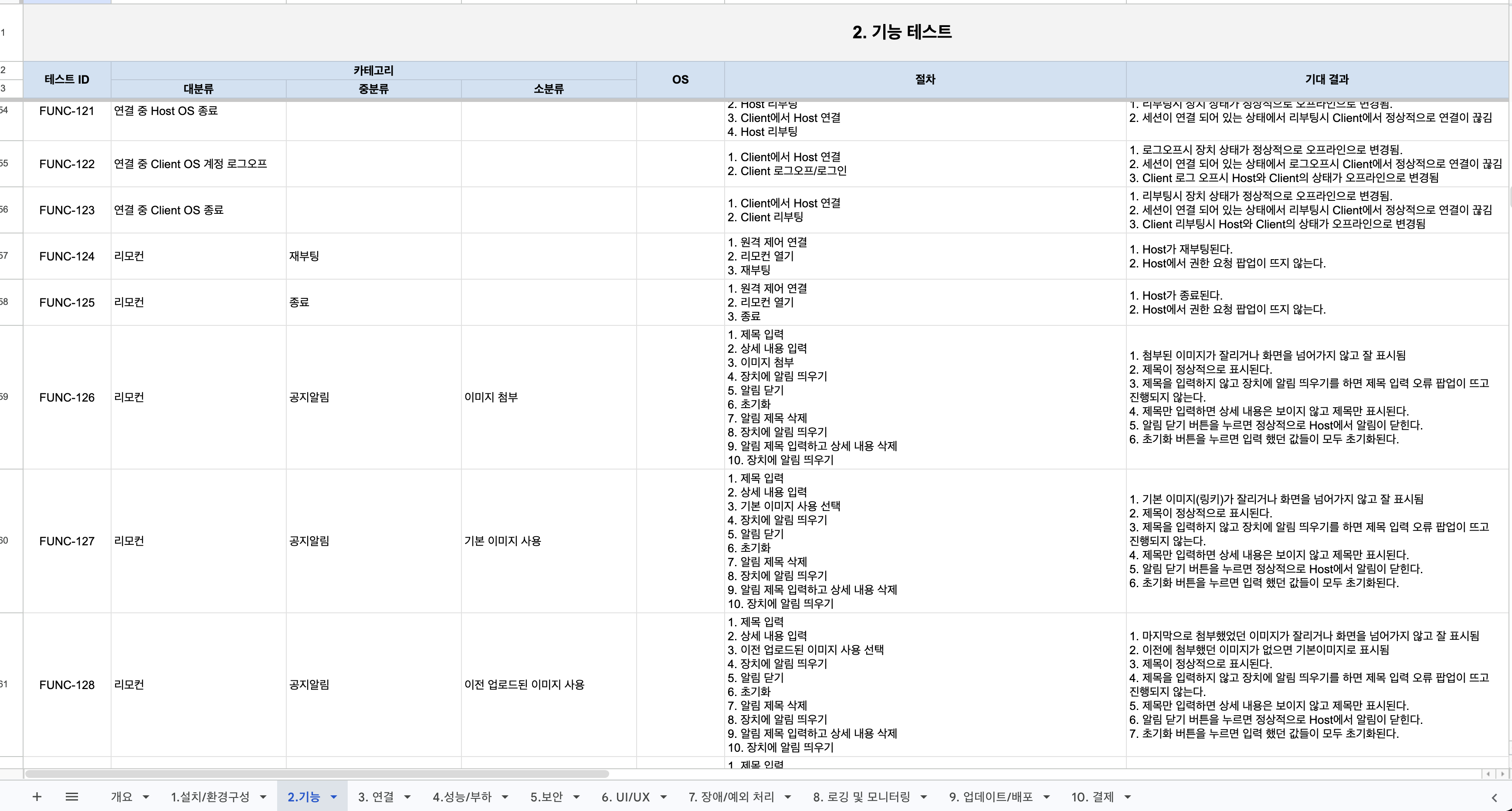

De ahí nace NovaLINK. No buscamos «otro programa» más: definimos y medimos el rendimiento según lo que importa en campo — calidad, latencia, FPS, comportamiento en redes difíciles y uso de recursos. La tubería de streaming y las estrategias de envío según cambio de pantalla se anclan a esos criterios. Antes de añadir funciones, comprobamos que el camino principal cumpla nuestros estándares. Repetimos pruebas en varios escenarios, recreando patrones reales para encontrar cuellos de botella. Revisamos números y sensación: cómo cambia la percepción al bajar el tráfico a igual resolución, con qué frecuencia se rompe la imagen en enlaces con pérdidas. Fijando el entorno y midiendo en serie, separamos mejora real de casualidad. El objetivo no es un eslogan, sino un estándar que nos convenza. Las prioridades dependen del uso; conviene definirlas juntos al inicio.

- Prueba comparativa de caídas de fotogramas en el mismo entorno

- SO: Windows 10, 32 bits

- CPU: Intel(R) Celeron(R) CPU J1900 @ 1.99GHz

- RAM: 4GB

- Fuente de vídeo: https://youtu.be/KxMqSz8qVSg

- Caso: reproducción en el Host y captura de pantalla en el Client

Con franqueza, no hay software de control remoto «óptimo» para toda red, hardware e industria: hay demasiadas variables (línea, firewall, posición del relay, especificaciones del equipo, otros programas). La misma solución puede ir rápida en la intranet y resultar frustrante hacia una oficina en el extranjero. No es justo resumirlo en «producto malo», pero para el usuario el resultado es el mismo: lentitud y estrés. Aun así desarrollamos NovaLINK con objetivos claros: menos latencia innecesaria, calidad de pantalla legible y utilidad práctica en condiciones reales de campo. No «número uno en todas partes», sino ampliar el alcance donde podemos responsabilizarnos y mejorar ahí dentro de forma coherente. Sin definir ese alcance, no podemos juzgar el progreso. Creemos que fijar y validar nuestra propia definición de rendimiento es lo que fija la dirección del producto.

Seguiremos afinando criterios con feedback y mediciones reales. Cuanto más transparente sea la definición, más honesta base de comparación para quien evalúe la adopción. En este blog compartiremos métodos, interpretación y ensayo-error en la mejora.